Ce qu'il faut retenir

- Trois lancements coordonnés en quelques semaines : Cursor Security Review, Claude Security (Anthropic, basé sur Opus 4.7), GPT-5.4-Cyber et GPT-5.5-Cyber (OpenAI).

- Sur le benchmark XBOW : GPT-5 manquait 40% des CVE connus, GPT-5.5 ne manque plus que 10%. Claude Opus 4.6 atteint 18%.

- Anthropic a engagé 100 millions de dollars de crédits d'usage et 4 millions de donations pour l'open-source security.

- OpenAI a lancé son Trusted Access for Cyber program avec 10 millions de dollars dédiés.

- La cybersécurité devient le premier vrai terrain de déploiement industriel des agents IA en entreprise.

- Pour les DSI et RSSI : repenser le "build vs buy", cadrer la gouvernance des prompts, sécuriser les compétences hybrides.

Verdict en 30 secondes

La cybersécurité est le premier secteur où les agents IA passent au stade industriel. Trois acteurs majeurs ont aligné leurs lancements en quelques semaines, avec des chiffres difficilement contestables :

- Claude Mythos Preview (Anthropic) découvre des milliers de failles inconnues. Accès restreint à 50 organisations.

- GPT-5.5-Cyber (OpenAI) atteint 90% sur le benchmark XBOW (test standard de détection de failles), soit 30 points de plus que GPT-5.

- Claude Security (Anthropic, public bêta) scanne automatiquement le code via Claude Opus 4.7.

Pour un DSI (Direction des Systèmes d'Information) ou un RSSI (Responsable de la Sécurité), la question n'est plus faut-il déployer mais comment cadrer.

Trois lancements coordonnés en quelques semaines

Anthropic a lancé Claude Security en bêta publique sur Claude Enterprise. L'outil, propulsé par Claude Opus 4.7, fait passer chaque ligne de code au crible : il repère les vulnérabilités, propose des correctifs ciblés et fournit pour chaque trouvaille un score de confiance, une évaluation de la sévérité et un mode opératoire pour reproduire le bug. En clair : un copilote sécurité qui ne dort jamais.

En parallèle, Anthropic a publié Claude Mythos Preview dans le cadre de Project Glasswing, un modèle si puissant qu'il a été jugé trop dangereux pour une diffusion publique. Accès restreint à environ 50 partenaires choisis : AWS, Apple, Microsoft, Google, Cisco, JPMorgan Chase, NVIDIA, Palo Alto Networks et plus de 40 organisations responsables d'infrastructures critiques. Mythos a découvert des milliers de zero-days (failles inconnues jusque-là) dans des systèmes massivement déployés comme OpenBSD ou Firefox. Anthropic a mis sur la table 100 millions de dollars en crédits d'usage et 4 millions de donations pour soutenir la sécurité open source.

Voici la présentation officielle d'Anthropic, qui détaille le programme et ses partenaires :

Anthropic a annoncé le programme directement sur X :

OpenAI a répondu en déployant GPT-5.4-Cyber puis GPT-5.5-Cyber via son Trusted Access for Cyber program, un accès contrôlé réservé à ceux qui prouvent qu'ils sont du côté des défenseurs : fournisseurs de sécurité, opérateurs d'infrastructures critiques, plateformes cloud, banques. Le programme dispose d'une enveloppe de 10 millions de dollars en subventions API. Il a déjà rallié des poids lourds : Bank of America, BlackRock, BNY, Citi, Cisco, Cloudflare, CrowdStrike, Goldman Sachs, JPMorgan Chase, Morgan Stanley, NVIDIA, Oracle, Palo Alto Networks, US Bank et Zscaler.

OpenAI a confirmé l'extension du programme sur X :

Et Sam Altman a personnellement annoncé le rollout de GPT-5.5-Cyber :

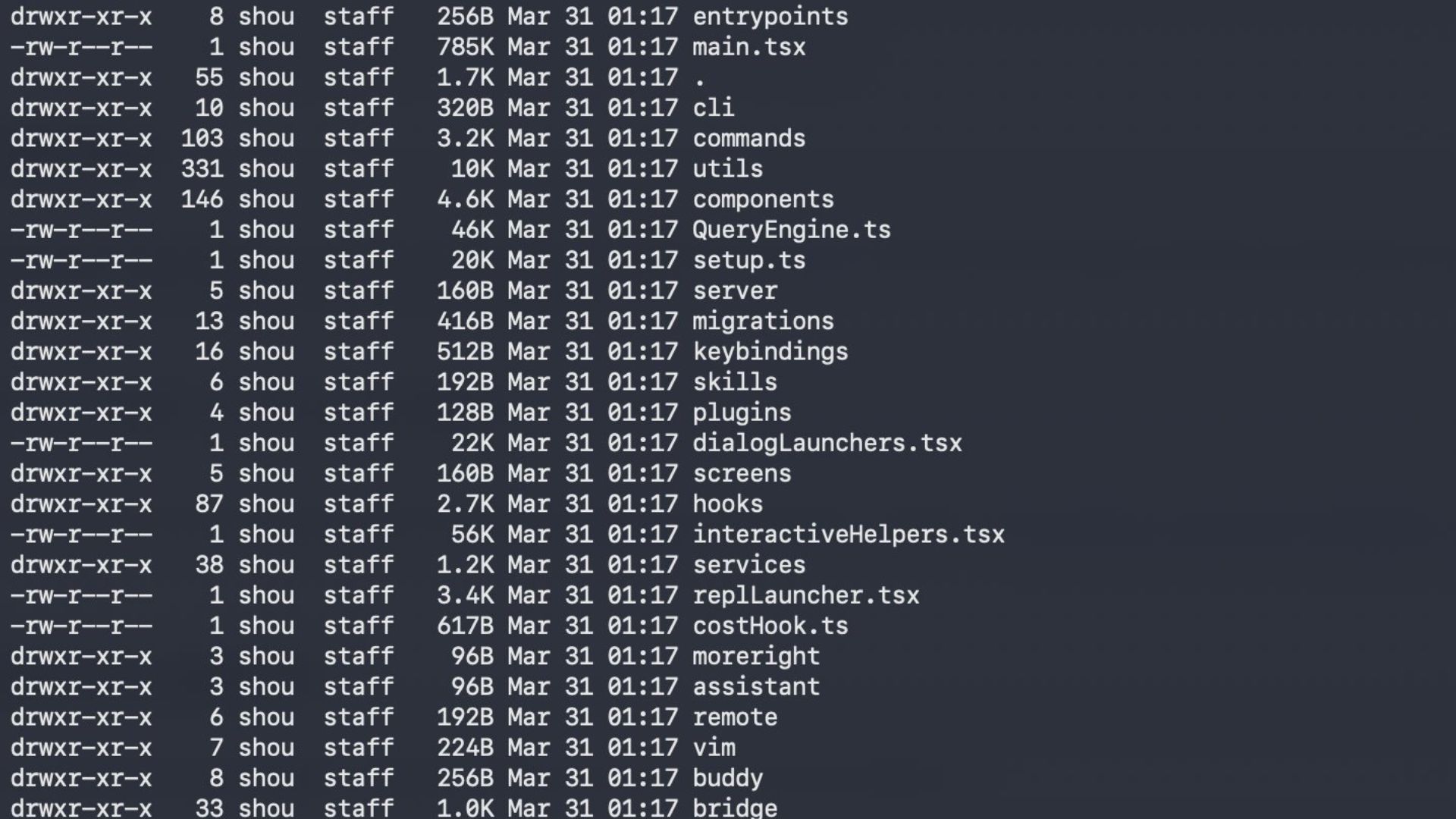

Enfin, Cursor a sorti Security Review le 30 avril 2026. Le concept : deux agents IA toujours actifs qui travaillent en arrière-plan dans l'environnement de développement (l'IDE). Le premier, Security Reviewer, contrôle chaque pull request (proposition de modification de code) avant qu'elle ne soit validée. Le second, Vulnerability Scanner, lance des scans planifiés sur l'ensemble du code existant. Disponibles en bêta sur les plans Teams et Enterprise. Pour le contexte business autour de Cursor, lire le deal à 60 milliards qui secoue l'écosystème IDE IA.

Pourquoi tous ces acteurs s'alignent en même temps

Trois moteurs convergent.

1. La surface d'attaque explose avec l'IA générative. Plus les équipes utilisent l'IA dans le code, dans les workflows et dans les bases de données, plus le nombre de portes d'entrée potentielles pour un attaquant grandit. Sans agents IA côté défense, le défenseur reste structurellement en retard sur l'attaquant. C'est exactement ce que mesure l'Anthropic Economic Index 2026 sur l'adoption massive de l'IA en entreprise.

2. Le RSSI ne peut plus tout couvrir manuellement. Le volume d'alertes, de logs et de revues de code dépasse depuis longtemps la capacité humaine. Les agents IA absorbent les niveaux de tri 1 et 2 (les vérifications les plus répétitives), et libèrent du temps pour les vraies décisions stratégiques.

3. La régulation pousse. NIS2 (sécurité des réseaux et systèmes d'information), DORA (résilience opérationnelle des services financiers) et IA Act (cadre européen de l'IA) imposent de plus en plus de gouvernance, de traçabilité et de capacité à répondre rapidement à un incident. Sans IA défensive, la conformité devient hors de portée pour les ETI moyennes. La pression réglementaire est aussi politique : voir le bras de fer Anthropic et Pentagone pour comprendre les enjeux de sécurité nationale.

Comparatif technique des quatre lancements

Les chiffres qui comptent : XBOW, AISI et CyberGym

Trois benchmarks de référence permettent de comparer les modèles sur le terrain.

XBOW mesure la capacité à détecter les failles déjà répertoriées (les CVE, pour Common Vulnerabilities and Exposures, le catalogue mondial des vulnérabilités connues). GPT-5 manquait 40% des failles. Claude Opus 4.6 a réduit ce taux à 18%. GPT-5.5 ne manque plus que 10% des failles. Autrement dit, là où un modèle passait à côté de 4 vulnérabilités sur 10 il y a six mois, il en rate seulement 1 sur 10 aujourd'hui.

L'UK AI Security Institute (AISI), l'organisme britannique d'évaluation de la sécurité IA, a testé une attaque corporate à 32 étapes (équivalente à 20 heures de travail d'un expert humain) : GPT-5.5 réussit dans 2 cas sur 10, Claude Mythos dans 3 cas sur 10. Hier seulement, aucun modèle n'y arrivait. La trajectoire est plus parlante que le score absolu.

Plus impressionnant encore, sur le benchmark CyberGym (reproduction de vulnérabilités connues), Mythos Preview a obtenu 83,1% contre 66,6% pour Claude Opus 4.6. Et l'exemple qui marque les esprits : Mythos a trouvé une faille dans OpenBSD passée inaperçue depuis 27 ans, et un bug dans FFmpeg qui avait survécu à 5 millions de passes de scanners automatisés sur 16 ans. Ce que les humains et les outils traditionnels n'ont pas vu pendant près de trois décennies, l'IA l'a trouvé en quelques heures.

Trois implications stratégiques pour un DSI ou un RSSI d'ETI

1. Le "build vs buy" se rejoue. Vos équipes sécurité développaient peut-être leurs propres outils en interne. La donne change : les agents IA fournis par les éditeurs deviennent compétitifs sur la détection et la remédiation. Concentrez vos équipes sur l'orchestration (faire travailler ensemble plusieurs outils) et la gouvernance, pas sur la brique de base.

2. La gouvernance des prompts devient un sujet de RSSI. Concrètement : qui a le droit de soumettre du code à Claude Security ? Avec quel niveau de confidentialité ? Comment auditer ce que l'agent a fait ? Ces questions doivent être tranchées avant le déploiement, pas après.

3. Les compétences hybrides cybersécurité plus IA deviennent rares et chères. Un analyste SOC (Security Operations Center, le centre de surveillance sécurité) capable de cadrer un agent IA, de challenger ses sorties et de détecter ses faux positifs sera l'un des profils les plus tendus du marché en 2027. Anticipez maintenant.

Quatre pièges à éviter dans le déploiement d'IA cybersécurité

1. Soumettre des données sensibles à un modèle grand public

Les agents IA cybersécurité publics ne sont pas adaptés à toutes les données. Pour les codes propriétaires ou les configurations critiques, privilégiez les déploiements vetted (accès contrôlé et vérifié), comme Trusted Access for Cyber d'OpenAI ou les accès partenaires d'Anthropic. Ou même du on-premise (hébergement chez vous).

2. Confondre détection et remédiation

Un agent IA peut très bien détecter une vulnérabilité sans avoir le contexte métier pour la corriger sans casser autre chose. La validation humaine reste indispensable sur les correctifs envoyés en production.

3. Ignorer la dimension offensive

Si Mythos peut découvrir des failles, des modèles équivalents finiront par tomber entre les mains des attaquants. Votre stratégie doit couvrir simultanément la défense et l'analyse de votre surface d'attaque. Le rappel récent sur Cursor (CVE-2026-26268, une faille permettant d'exécuter du code arbitraire) montre même que les outils IA eux-mêmes deviennent une surface d'attaque.

4. Déployer sans cadre de traçabilité

NIS2, DORA et l'IA Act exigent que chaque action automatisée soit tracée et auditable. Tout déploiement doit être pensé dès le départ pour répondre à un audit, pas seulement pour produire des résultats.

Comment Studeria peut vous aider

Notre Parcours Audit IA est calibré pour les ETI et grands groupes qui veulent cadrer la gouvernance IA avant de déployer. Nous auditons votre exposition (côté défense et côté surface d'attaque), définissons une politique d'usage des agents, formons les équipes au cadrage et au contrôle, et alignons votre dispositif aux exigences NIS2, DORA et IA Act.

Le réflexe à avoir ce trimestre

Lancez un audit de votre exposition aux agents IA, à la fois côté défense et côté attaque. Combien de vos équipes utilisent déjà des agents IA sans cadre formel ? Combien de vos workflows critiques pourraient être détournés par une injection de prompt (technique qui consiste à piloter un agent IA via des instructions cachées) ? Cet état des lieux est la base de votre stratégie de gouvernance IA pour 2026.

Sources et références

- Anthropic (officiel) : Project Glasswing

- Anthropic (officiel) : Project Glasswing partners

- Anthropic Frontier Red Team : Claude Mythos Preview (détails techniques)

- OpenAI (officiel) : Trusted Access for Cyber Defense

- OpenAI (officiel) : Accelerating the cyber defense ecosystem

- OpenAI : GPT-5.5 System Card

- Cursor (officiel) : Security Review changelog 30 avril 2026

- Cursor (officiel) : Securing our codebase with autonomous agents

- Infosecurity Magazine : Anthropic Rolls Out Claude Security

- Orange Cyberdefense : Anthropic and OpenAI unveil Mythos and GPT-Cyber

À lire aussi sur Studeria :

- Projet Glasswing : pourquoi Anthropic confie Claude Mythos aux géants de la tech

- Claude Opus 4.7 : le guide complet du nouveau modèle d'Anthropic

- GPT-5.5 vs Claude Opus 4.7 : quel modèle IA choisir en 2026

- Anthropic vs Pentagone : pourquoi Trump a banni Claude

- Elon Musk veut racheter Cursor 60 milliards

- Anthropic Economic Index 2026 : ce que les données révèlent sur l'IA au travail

- SEO et GEO en 2026 : les 9 méthodes Princeton

FAQ article

Faut-il déployer ces agents en interne ou en SaaS ?

Comment cadrer la gouvernance des prompts dans un grand groupe ?

Comment ces outils s'intègrent-ils avec mon SIEM existant ?

Quel ROI attendre la première année ?

Comment former mes équipes à ces nouveaux agents ?

Faut-il s'inquiéter de Mythos pour la sécurité globale ?

Quelle différence entre GPT-5.5-Cyber et un EDR/XDR classique ?

4,9/5

Boostez vos compétences

+5000 apprenants formés

Nos parcours s’adaptent à vos objectifs, à votre rythme et à votre niveau.

4,7/5

sur 171 avis

+200 entreprises formées à l’IA

De la startup au grand groupe, nos parcours sont pensées pour déployer des solutions performantes avec l’IA .

Prêt à te former ?

Trois parcours selon ton objectif : apprendre, te certifier, ou lancer ton activité.

Parcours Incubateur IA

Comprenez l’IA, gagnez du temps au quotidien et valorisez votre profil professionnel

Parcours Accélérateur IA

Implémentez l’IA grâce à un accompagnement stratégique et opérationnel pour structurer, automatiser et scaler votre business

Parcours Implémentation & Agent IA

TPE, PME, ETI : Un parcours stratégique pour former vos équipes et implémenter les bons outils IA dans votre entreprise.

Du dimanche 5 avril au jeudi 9 avril 2026

Le sommet IA 2026

Cinq soirées de démonstrations live, de conseils actionnables et d'échanges avec certains des entrepreneurs et experts les plus influents de France, le tout sans écrire une seule ligne de code.