Résumé

Jeudi, Anthropic refuse un contrat avec le Pentagone pour des raisons éthiques. Vendredi, Trump signe un décret bannissant Claude des systèmes gouvernementaux américains. Le samedi, OpenAI signe le contrat décliné. Anthropic perd court terme un contrat stratégique mais gagne en cohérence de marque. L'affaire revèle le dilemme fondamental auquel font face toutes les startups IA : éthique vs croissance, quand les gouvernements deviennent les plus grands clients du secteur.

Jeudi, Anthropic dit non au Pentagone. Vendredi, Trump les bannit. Le même soir, OpenAI signe le contrat. Samedi, on apprend que Claude a été utilisé pour frapper l'Iran. Retour sur la semaine qui a changé les règles du jeu entre l'IA et le pouvoir.

Ce qui s'est passé la dernière semaine de février 2026, ce n'est pas un fait divers tech. C'est un moment charnière. Pour la première fois, une entreprise d'IA a dit non au gouvernement américain. Pour la première fois, un président américain a banni une entreprise tech nationale en la désignant « risque pour la sécurité nationale ».

La chronologie : 4 jours qui ont tout changé

Jeudi 27 février : Anthropic dit non

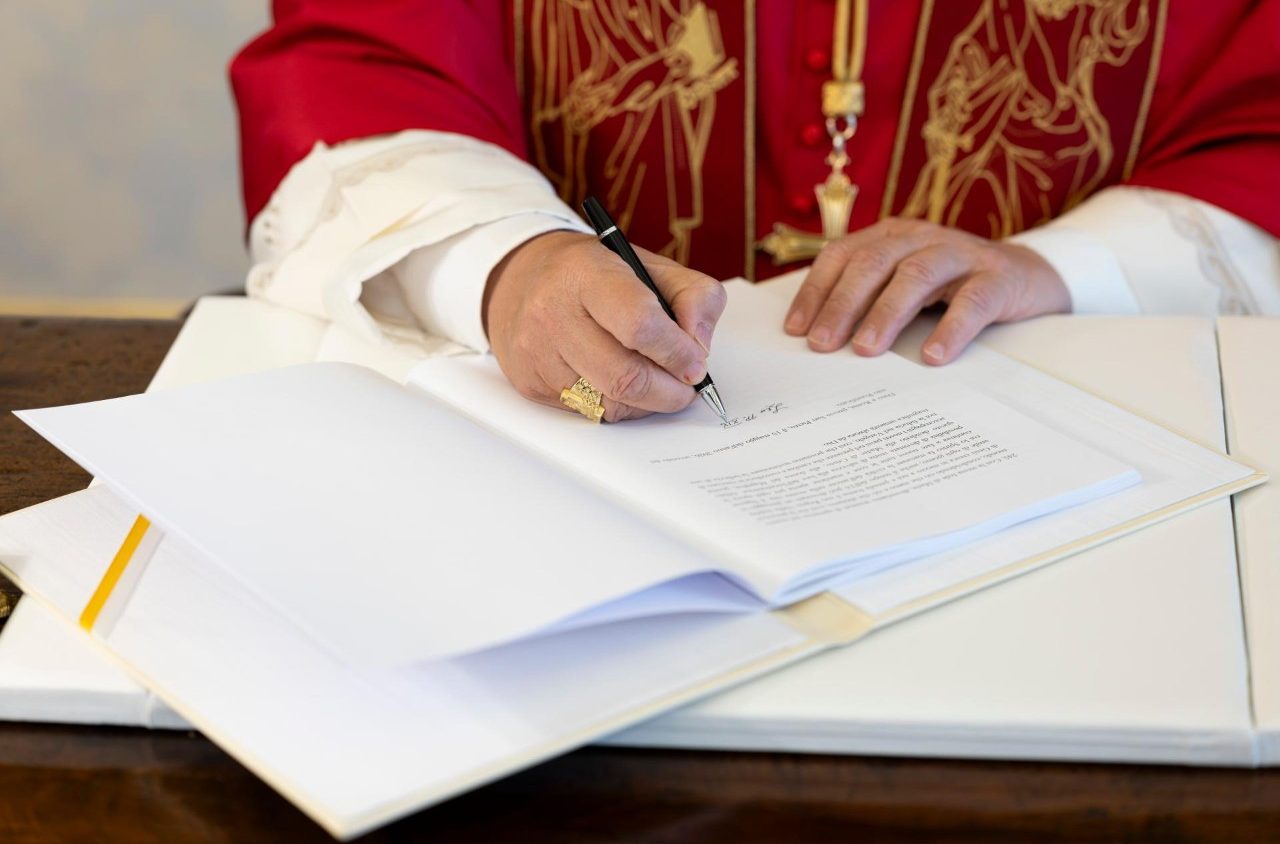

Dario Amodei, le CEO d'Anthropic, publie une déclaration. Deux lignes rouges, non négociables : pas d'armes autonomes sans supervision humaine. Pas de surveillance de masse des citoyens américains.

Amodei ne bouge pas. Ses mots, publiés sur le site d'Anthropic : « Nous ne pouvons pas, en conscience, accéder à leur demande. »

Vendredi 28 février : L'escalade

L'ultimatum expire. Anthropic ne cède pas. Trump publie sur Truth Social et ordonne à toutes les agences fédérales de cesser d'utiliser Anthropic.

Pete Hegseth, le Secrétaire de la Défense, désigne Anthropic comme « risque pour la chaîne d'approvisionnement de la sécurité nationale », un label réservé jusqu'ici aux adversaires étrangers des États-Unis. C'est du jamais vu pour une entreprise américaine.

Le même soir, Sam Altman poste sur X qu'OpenAI a signé un accord avec le Pentagone. Celui qui défendait les mêmes lignes rouges 24 heures plus tôt prend le contrat.

Samedi 1er mars : Les frappes et la révélation

Les États-Unis et Israël lancent des frappes massives sur l'Iran. Et le Wall Street Journal révèle que l'armée américaine a utilisé Claude pendant ces frappes. Le US Central Command a utilisé Claude pour des évaluations de renseignement, l'identification de cibles et la simulation de scénarios de combat.

La même IA que Trump venait de bannir. Quelques heures après le décret.

Ils ont banni l'entreprise. Ils avaient besoin de la technologie. Alors ils l'ont utilisée quand même.

Le double jeu d'OpenAI : lisez les petits caractères

Sur les armes autonomes

Anthropic demandait : « Pas d'armes entièrement autonomes sans supervision humaine. » Un humain impliqué dans la décision. Avant le tir. Le contrat OpenAI stipule : « Responsabilité humaine dans l'usage de la force. » Quelqu'un de responsable. Ce qui peut être vérifié après coup. Supervision ≠ responsabilité.

Sur la surveillance

Anthropic voulait des protections au-delà du cadre légal actuel. Le contrat OpenAI dit que le Pentagone « reflète ces principes dans la loi et la politique existantes ». La loi existante. Exactement celle qu'Anthropic jugeait insuffisante.

Oppenheimer et Truman : le parallèle qui fait froid dans le dos

En 1945, Robert Oppenheimer crée la bombe atomique puis va voir le président Truman : « Monsieur le Président, j'ai l'impression d'avoir du sang sur les mains. » Truman l'écarte et se tourne vers des scientifiques plus enthousiastes. La bombe H est née.

Les parallèles sont glaçants. Le créateur de la technologie la plus puissante de son époque pose des limites morales. Le pouvoir l'écarte. Le pouvoir se tourne vers quelqu'un de plus arrangeant. Oppenheimer, c'est Amodei. Truman, c'est Trump. Teller, c'est Altman. Et la bombe atomique, c'est l'IA.

Pourquoi ça vous concerne (même si vous n'êtes pas dans la défense)

Ce que ça change pour l'industrie de l'IA

Le précédent créé cette semaine est sans équivalent. Un gouvernement démocratique a effectivement puni une entreprise tech pour avoir refusé de retirer des garde-fous éthiques. Le signal envoyé au reste de l'industrie est limpide : pliez-vous ou on vous détruit.

Ce que ça change pour les utilisateurs de Claude

Claude ne va pas disparaître. Anthropic est valorisée à 380 milliards de dollars. Amodei a souligné que la valorisation et les revenus d'Anthropic n'ont fait qu'augmenter depuis le début du conflit. Mais la désignation « risque pour la sécurité nationale » a un effet domino potentiel. Si vous êtes une entreprise qui travaille avec le gouvernement américain, vous devez peut-être repenser votre stack IA.

Ce que ça change pour la régulation de l'IA

La question centrale n'est plus « faut-il réguler l'IA ? » C'est : qui décide des limites ? Celui qui crée la technologie ? Celui qui la finance ? Celui qui l'utilise ? Cette semaine a montré que ces questions ne sont plus théoriques.

Ce qu'on en pense chez Studeria

On ne prend pas parti sur la géopolitique. Mais on observe trois choses.

Premièrement, cette semaine prouve que l'IA n'est plus un outil de productivité. C'est une infrastructure critique. La question de la gouvernance est incontournable, que vous soyez un État ou une PME de 15 personnes.

Deuxièmement, la position d'Anthropic sur la sécurité n'est pas du marketing. Quand une entreprise sacrifie un contrat de 200 millions de dollars et accepte d'être blacklistée par le gouvernement le plus puissant du monde pour tenir ses principes, ce n'est pas du greenwashing.

Troisièmement, et c'est le plus important pour nos clients : aucun de ces événements ne change la valeur de Claude comme outil de travail. Les modèles restent les mêmes. L'écosystème reste intact. Pour un professionnel, un indépendant ou une entreprise en France, Claude reste l'outil le plus performant pour le raisonnement, l'analyse et la production de contenu.

Les questions qui restent ouvertes

- Juridique. Anthropic a annoncé qu'il contesterait la désignation « risque sécurité nationale » devant les tribunaux.

- Industriel. Plus de 100 employés de Google ont envoyé une lettre demandant les mêmes limites qu'Anthropic pour l'utilisation militaire de Gemini.

- Législatif. Des sénateurs des deux partis ont demandé à Hegseth et Amodei de prolonger les négociations et de travailler avec le Congrès.

- Éthique. L'IA est désormais utilisée dans des opérations militaires en temps réel : renseignement, identification de cibles, simulation de scénarios de guerre. Sans cadre international.

Ce que ça veut dire pour vous, concrètement

Si vous êtes professionnel ou en reconversion : cette semaine rappelle que l'IA n'est pas un gadget. Comprendre ses enjeux, pas seulement ses fonctionnalités, c'est ce qui distingue un utilisateur éclairé d'un simple opérateur.

Si vous êtes indépendant ou consultant : vos clients vont vous poser des questions. Être capable de leur répondre avec nuance et précision, c'est un avantage concurrentiel.

Si vous dirigez une entreprise : la question de la gouvernance IA n'est plus théorique. Quels outils vous utilisez, dans quel cadre, avec quelles données, sous quelles conditions, ces questions méritent des réponses structurées.

Ce qu'on retient

Cette semaine n'est pas un incident. C'est un tournant. L'IA est entrée dans la guerre. Pas en théorie. En pratique. Sur un champ de bataille réel, dans des frappes réelles, avec des conséquences réelles. Et la question qui se posait à Oppenheimer en 1945 se pose aujourd'hui à toute l'industrie de l'IA : qui contrôle ce qu'on a créé ?

📩 Notre newsletter IA | 🔗 Nos formations et accompagnements | 📞 Échangeons

Sources

FAQ article

Claude va-t-il être supprimé ou devenir inaccessible ?

Anthropic est-il en danger financier ?

L'accord OpenAI est-il identique à ce qu'avait Anthropic ?

Claude a-t-il vraiment été utilisé dans les frappes sur l'Iran ?

Quel est le parallèle avec Oppenheimer ?

Est-ce que ça change quelque chose pour les entreprises françaises qui utilisent Claude ?

4,9/5

Boostez vos compétences

+5000 apprenants formés

Nos parcours s’adaptent à vos objectifs, à votre rythme et à votre niveau.

4,7/5

sur 171 avis

+200 entreprises formées à l’IA

De la startup au grand groupe, nos parcours sont pensées pour déployer des solutions performantes avec l’IA .

Prêt à te former ?

Trois parcours selon ton objectif : apprendre, te certifier, ou lancer ton activité.

Parcours Incubateur IA

Comprenez l’IA, gagnez du temps au quotidien et valorisez votre profil professionnel

Parcours Accélérateur IA

Implémentez l’IA grâce à un accompagnement stratégique et opérationnel pour structurer, automatiser et scaler votre business

Parcours Implémentation & Agent IA

TPE, PME, ETI : Un parcours stratégique pour former vos équipes et implémenter les bons outils IA dans votre entreprise.

Du dimanche 5 avril au jeudi 9 avril 2026

Le sommet IA 2026

Cinq soirées de démonstrations live, de conseils actionnables et d'échanges avec certains des entrepreneurs et experts les plus influents de France, le tout sans écrire une seule ligne de code.